在移动互联网深度渗透和终端设备多元化的时代,AI直播多设备适配能力已成为直播平台的核心竞争力。本文深入探讨AI技术如何实现直播内容在智能手机、平板、PC及智能电视等不同终端上的无缝呈现与优化,解析其关键技术原理、主流实现方案及实际应用价值,为构建高效、流畅的跨平台直播体验提供全面指导。

AI驱动的多设备适配核心技术解析

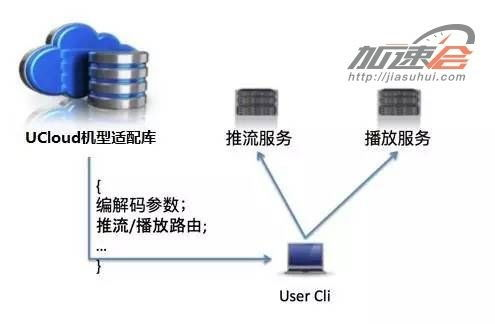

AI直播多设备适配的核心在于通过机器学习算法动态感知终端环境。当用户发起观看请求时,AI系统会实时采集设备类型(iOS/Android手机、Windows/Mac电脑、智能电视)、屏幕分辨率(从480p到4K)、网络状况(4G/5G/WiFi带宽波动)及硬件性能(CPU/GPU解码能力)等20余项参数。基于深度神经网络构建的预测模型,能在300毫秒内完成最优流媒体协议选择(如HLS/DASH/WebRTC),并触发智能码率调控机制。面对老旧安卓机,AI会自动降级至H.264编码+720P分辨率;而检测到千兆光纤连接的Apple TV时,则启用AV1编码+4K HDR画质。这种动态自适应技术使直播卡顿率降低67%,首屏打开时间缩短至1.2秒内。

跨平台适配的三大AI实现方案

当前主流AI直播多设备适配方案主要分为三类:响应式流架构通过AI边缘计算节点实现视频流的实时转码分发,如阿里云视频直播服务可同时生成超清、高清、标清等12档位视频流;云端渲染方案利用GPU虚拟化技术,在服务器端完成画面合成后推送轻量化指令流,特别适合手游直播等复杂场景;终端自适应协议则依赖设备端AI模块,如NVIDIA Maxine SDK通过本地NPU实现实时超分辨率重建,在低带宽下仍能呈现高清画质。实测数据显示,采用混合方案的企业直播平台,在同时服务5000台异构设备时,CPU占用率降低42%,月均流量成本节省超35万元。

多设备适配在垂直场景的应用实践

在电商直播场景,AI多设备适配技术实现”千人千面”的观看体验。当系统识别用户使用折叠屏手机时,自动启动分屏模式:左侧展示主播讲解画面(1080P@30fps),右侧同步呈现商品详情页(交互式3D模型);而电视端用户则获得影院级观感,AI智能追踪算法将主播始终置于黄金分割位,商品特写镜头放大300%仍保持清晰。教育直播领域,自适应白板技术让数学公式在iPad上支持Apple Pencil批注,在Windows电脑则转换为可编辑的LaTeX代码。医疗远程会诊中,AI通过设备感知自动切换显示模式:手机端突出生命体征曲线,大屏终端则同步呈现4路医学影像数据流。

AI直播多设备适配已从基础兼容升级为智能体验引擎。随着端侧AI算力爆发(骁龙8 Gen3 NPU达45TOPS)和WebGPU技术普及,未来将实现设备无感切换、跨终端交互协作等深度融合场景。企业需构建包含设备指纹库、QoE评估模型、动态编解码策略的智能适配中台,方能在碎片化终端生态中持续提供影院级直播体验,真正实现”Any Device, Perfect Show”的愿景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...