随着AI技术深度赋能直播行业,从虚拟主播、智能内容审核到个性化推荐,创新应用层出不穷。技术狂欢背后潜藏着严峻的合规挑战。本文将系统剖析AI直播的核心应用场景,揭示关键法律风险点,并提供可落地的合规审查框架与操作指南,助力平台及从业者在创新与合规间找到平衡点。

AI直播的核心技术应用场景与潜在合规隐患

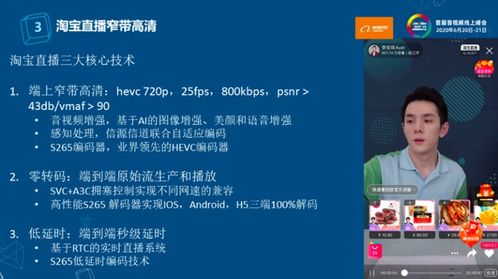

人工智能技术在直播领域的渗透已形成多维度应用生态。虚拟数字人主播通过深度学习与实时渲染技术,实现7×24小时不间断直播,显著降低人力成本,但其形象、声音若未经授权模仿真人明星或公众人物,将直接侵犯肖像权、名誉权,甚至构成不正当竞争。智能内容审核系统依赖计算机视觉与自然语言处理技术,对海量直播流进行实时监测,自动拦截违规内容。算法误判可能导致正常内容被误封,引发用户投诉及法律纠纷。个性化推荐算法基于用户行为数据精准推送直播内容,若过度依赖“信息茧房”效应或利用用户心理弱点诱导打赏、消费,则涉嫌违反《个人信息保护法》及《消费者权益保护法》关于公平交易和知情同意的规定。深度伪造(Deepfake)技术在直播中的滥用风险尤为突出,伪造名人直播带货或政治人物发表不当言论,可能触犯《网络安全法》第二十七条关于禁止传播虚假信息的规定,甚至构成刑事犯罪。

AI直播面临的五大法律风险矩阵与审查要点

开展AI直播合规审查必须系统识别以下风险领域:内容安全风险方面,需依据《网络信息内容生态治理规定》建立三级(违法、不良、适宜)内容识别标准,重点审查AI生成内容是否含有暴力、色情、虚假广告等违禁元素。数据合规风险要求平台严格遵守《个人信息保护法》,对AI系统采集的用户面部特征、声纹、观看时长等生物识别信息及行为数据,必须获得单独同意,并实施匿名化处理。算法透明风险涉及《互联网信息服务算法推荐管理规定》,平台需向用户明示AI推荐机制的基本原理、目的和主要参数,提供关闭个性化推荐选项,避免“大数据杀熟”。知识产权风险需警惕AI自动生成的直播脚本、音乐、图像是否侵犯他人著作权,依据《著作权法》认定AI生成内容的权利归属。广告合规风险则聚焦《广告法》,AI主播口播内容若涉及医疗、金融等特殊商品,需核查广告资质与真实性承诺,杜绝虚假宣传。

构建AI直播全生命周期合规管理体系的实践路径

实现有效合规审查需建立贯穿AI直播开发、部署、运营全流程的管控机制。在开发设计阶段实施“合规前置”,将《网络直播营销管理办法》等法规要求内嵌至算法设计逻辑,设置打赏冷静期功能、未成年人保护模式。部署前需完成深度合规测试,包括:通过对抗样本检测AI审核系统漏洞,利用合规性数据集验证推荐算法偏差率,委托第三方机构进行安全评估并出具《算法合规审计报告》。运营阶段执行动态监控,建立AI行为日志追溯系统,对高风险操作(如大额打赏诱导)设置实时预警阈值,定期生成《AI直播合规风险热力图》。人员管理层面需组建跨部门合规小组,技术团队负责算法解释文档撰写,法务团队主导用户协议条款更新,运营团队落实应急响应预案。特别建议引入“合规科技”工具,部署区块链存证平台固化直播内容,运用隐私计算技术实现数据“可用不可见”,降低违规取证难度。

AI直播的合规审查绝非简单技术适配,而是涉及法律、伦理、技术的系统性工程。平台方需超越被动合规思维,将监管要求转化为核心竞争力——通过构建透明可溯的AI应用机制赢得用户信任,利用合规数据治理释放商业价值。唯有将风险防控深度植入AI基因,方能在监管收紧与行业创新的双重浪潮中行稳致远。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...