在人工智能深度赋能直播行业的当下,AI驱动的智能直播正以前所未有的速度重塑内容生产、用户互动与商业模式。技术狂飙突进的同时,其引发的数据隐私、算法偏见、内容安全、数字鸿沟等伦理挑战日益凸显。本文将深入探讨智能直播技术应用中的核心社会责任议题,剖析平台、开发者、主播与用户的多方责任边界,并提出构建健康生态的可行路径。

AI直播的技术特性与社会伦理挑战的必然关联

智能直播的核心驱动力在于其强大的数据处理与模式识别能力。通过计算机视觉分析直播画面,自然语言处理解析弹幕互动,机器学习算法预测用户偏好,AI实现了实时内容审核、虚拟主播生成、个性化推荐、互动玩法创新等功能跃迁。正是这些技术特性埋下了伦理风险的种子。深度伪造技术(Deepfake)在直播中的应用可能催生逼真的虚假身份,用于欺诈或传播不实信息;基于用户画像的“信息茧房”算法推荐,在提升粘性的同时可能加剧认知偏见与社会撕裂;自动化内容审核系统虽能高效拦截违规内容,但其算法决策的“黑箱”特性可能导致误判或文化偏见,尤其对边缘群体表达造成不公平压制。更严峻的是,大规模用户行为数据的采集与分析,触及隐私保护的敏感神经。智能直播平台如何平衡商业价值挖掘与用户数据权利保护,成为履行社会责任的首要考题。技术本身无善恶,但应用场景的广泛性与渗透力,使得智能直播的社会责任议题无法回避。

平台责任:构建透明、公平、安全的智能直播治理框架

作为智能直播生态的主导者,平台企业承担着首要且不可推卸的社会责任。这要求其超越简单的合规底线思维,主动构建负责任的AI治理体系。算法透明与可解释性是基石。平台需向用户清晰披露推荐机制、审核规则的基本逻辑,尤其在涉及账号限流、内容下架等影响用户权益的决策时,应提供申诉渠道与人工复核机制,避免算法暴政。数据安全与隐私保护必须置于战略高度。这包括实施严格的数据最小化原则、采用先进的加密与脱敏技术、赋予用户充分的知情同意权与数据控制权(如关闭个性化推荐、删除历史数据的选项),并建立完善的数据泄露应急响应机制。第三,打击有害内容与保障信息真实性是核心责任。平台需持续投入研发更精准、能识别文化语境与意图的多模态AI审核系统,尤其加强对虚假信息、仇恨言论、欺诈诱导的识别能力,同时建立与人工审核的协同机制,并探索区块链等技术在内容溯源中的应用。第四,促进数字包容与公平。智能直播平台应关注技术普惠,避免算法歧视加剧数字鸿沟,为残障人士优化交互界面,为老年用户提供简化操作模式,并在流量分配上给予优质但小众内容一定扶持。

面向未来:多方协同共治与技术向善的实践路径

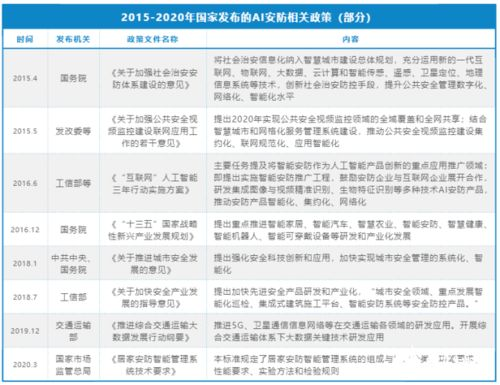

化解智能直播的社会责任困境,绝非单一主体可完成,需构建政府监管、行业自律、技术伦理、公众参与的多维共治格局。政策法规层面,监管机构应加快制定适应AI直播特性的专门法规,明确数据权属、算法问责、虚拟人身份认定等新型问题的法律边界,建立分级分类的动态监管机制,既防范风险又鼓励创新。行业自律层面,直播平台、技术供应商、MCN机构应联合制定并遵守《AI直播应用伦理公约》,建立第三方伦理评估与认证体系,共享最佳实践与风险信息。技术研发层面,推动“负责任创新”(Responsible Innovation)理念融入开发全流程。开发者需在模型训练阶段主动识别并修正偏见数据,设计具备“伦理开关”的AI系统(如可紧急中断的深度合成功能),探索隐私计算、联邦学习等“数据可用不可见”的技术路径,将伦理考量内化为技术标准。用户教育与赋能层面,平台应加强媒介素养教育,帮助用户识别AI生成内容、理解算法逻辑、保护个人隐私,并畅通用户反馈与参与治理的渠道。主播作为关键节点,需提升责任意识,审慎使用AI工具,明确标注虚拟形象或AI辅助内容,杜绝技术滥用。

智能直播的蓬勃发展,既是技术创新的礼赞,亦是对社会伦理底线的叩问。技术向善绝非空洞口号,而是要求所有参与者——平台、开发者、主播、用户乃至监管者——在追逐效率与流量的同时,始终将人的尊严、权利与社会的公平正义置于核心。唯有建立权责清晰、透明可信、多方共治的责任框架,将伦理考量深度融入技术研发与应用生态,智能直播才能真正释放其连接、赋能与创造的正向价值,驶向可持续发展的星辰大海。科技的温度,最终体现在其对人类福祉的深切关照之上。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...