在数字内容爆炸式增长的今天,海量视频的上传与传播带来了严重的重复内容问题。视频去重算法作为内容平台的核心技术,通过智能比对视频特征,精准识别并处理重复或高度相似的视频片段,有效维护内容生态的原创性与用户体验。本文将深入解析主流视频去重算法的技术原理、实现方式及实际应用场景。

一、视频去重算法的核心原理与技术基础

视频去重算法的核心目标是在不计较格式转换、分辨率调整、片段截取等操作的前提下,准确判断两段视频内容的相似性。其技术基础主要建立在数字指纹(Fingerprint)的生成与比对机制上。不同于简单的MD5或SHA1等传统文件哈希值(易受格式转换影响),视频指纹需具备鲁棒性(Robustness)与区分性(Discriminability)。鲁棒性指算法需抵抗亮度变化、色彩调整、画幅裁剪、添加水印/字幕、压缩失真等常见编辑操作;区分性则要求算法能精准区分不同视频内容,避免误判。主流算法通常采用分帧处理技术,将视频流按固定时间间隔(如每秒1-2帧)或场景切换点进行采样,再对每帧图像提取关键视觉特征。这些特征可能包括颜色直方图、边缘梯度方向、局部二值模式(LBP)或更先进的深度特征(如CNN提取的特征向量)。最终通过特定算法(如感知哈希pHash、差异哈希dHash)将高维特征压缩为紧凑的二进制或数值型指纹串,作为该视频片段的唯一“身份证”。

二、关键特征提取与指纹生成策略详解

特征提取是决定视频去重算法性能的核心环节。当前主流技术路线可分为三大类:基于关键帧的方法、基于时空特征融合的方法以及基于深度学习的方法。基于关键帧的方法聚焦于视频中具有代表性的单帧图像。,通过计算帧间差异自动选取场景切换点附近的关键帧,再对关键帧进行特征提取。常用的技术包括:

- 颜色特征:计算HSV空间下的颜色矩或颜色聚合向量(CCV),对光照变化具有较好稳定性;

- 纹理特征:利用Gabor滤波器组或灰度共生矩阵(GLCM)捕捉画面纹理模式;

- 局部特征:采用SIFT、SURF或ORB等算子检测关键点并生成描述符,适用于部分遮挡或视角变化。

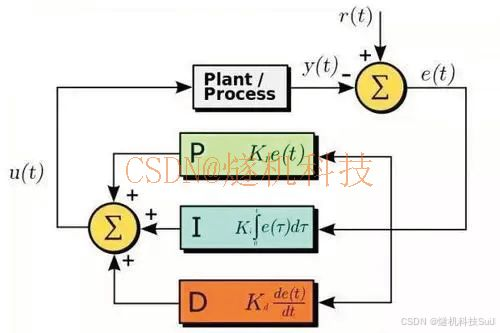

基于时空特征融合的方法则同时考虑空间(图像内容)和时间(帧间运动)信息。,在提取关键帧的SIFT特征后,进一步计算光流场(Optical Flow)获取相邻帧的运动矢量,将运动特征与视觉特征拼接形成时空描述符。而基于深度学习的方法利用预训练的卷积神经网络(如ResNet、VGG)提取深度特征。更先进的做法是采用3D CNN(如C3D、I3D)或双流网络(Two-Stream Network),前者直接处理视频片段立方体(Spatiotemporal Cuboid),后者分别处理RGB帧和光流帧并融合结果,能显著提升对复杂时空模式的捕捉能力。指纹生成阶段需将高维特征向量降维、二值化,常用方法包括局部敏感哈希(LSH)、主成分分析(PCA)后量化或自编码器(Autoencoder)压缩,最终生成定长、紧凑的指纹码。

三、高效指纹比对与相似度计算机制

当海量视频指纹存入数据库后,如何快速比对查询指纹与库中指纹的相似度成为关键挑战。常用技术包括倒排索引(Inverted Index)和局部敏感哈希(LSH)。倒排索引将指纹按特定分段(如每64位指纹分为4个16位段)建立索引表,查询时只需比对相同段号下的指纹子集,大幅缩小搜索范围。LSH则通过设计特殊哈希函数,使得相似指纹以高概率映射到相同“桶”(Bucket)中,实现近似最近邻搜索(ANN)。

相似度计算通常采用汉明距离(Hamming Distance,适用于二进制指纹)或余弦相似度(适用于向量指纹)。对于两段视频,需进行指纹序列的匹配对齐:

- 滑动窗口比对:在时间轴上滑动查询视频的指纹序列,与目标视频的每个可能位置计算平均相似度;

- 动态时间规整(DTW):解决因播放速度差异导致的指纹序列长度不一致问题,找到最优匹配路径;

- 局部敏感哈希链:将连续指纹分组为“超级指纹”(Super Fingerprint),先粗筛再精匹配,提升效率。

最终相似度得分需结合匹配片段长度、相似度峰值及时间连续性综合判定,避免因短暂画面相似导致误报。

四、实际应用场景与系统优化挑战

视频去重算法广泛应用于各大内容平台。YouTube的Content ID系统通过版权方上传参考指纹库,自动扫描用户上传内容,实现版权保护;TikTok/抖音则利用去重技术抑制重复或低创内容的传播,提升推荐质量;网盘服务商通过去重减少存储冗余,降低运营成本。在系统实现中,需应对以下挑战:

- 大规模实时处理:采用分布式计算框架(如Spark、Flink)并行处理上传视频的指纹提取;

- 索引优化:使用Elasticsearch或专用ANN库(FAISS、Milvus)加速十亿级指纹检索;

- 对抗性攻击防御:针对添加噪声、画中画、镜像翻转等对抗手段,需在特征提取阶段加入不变性处理(如傅里叶-梅林变换抗旋转);

- 阈值动态调整:根据内容类型(影视剧、UGC短视频)设定差异化相似度阈值,平衡查全率与查准率。

未来趋势将更依赖端到端的深度视频表征学习,结合自监督训练减少对标注数据的依赖,并探索多模态融合(结合音频指纹)提升复杂场景下的鲁棒性。

视频去重算法作为数字内容治理的关键基础设施,其技术演进持续推动着内容生态的健康发展。从基础的关键帧特征提取,到融合时空信息的深度学习模型,再到应对十亿级规模的高效检索架构,该领域不断突破性能瓶颈。未来随着多模态理解与自监督学习的深化,视频去重技术将在版权保护、内容审核、存储优化等场景发挥更精准高效的作用,为构建纯净、创新的数字视频环境提供坚实保障。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...